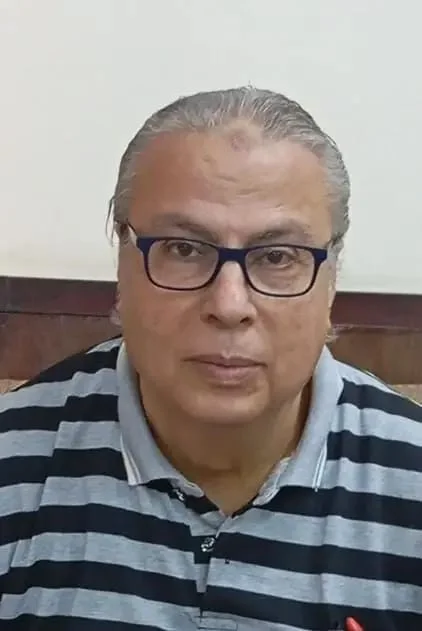

بقلم/ الدكتور إيهاب مجاهد، أستاذ الإذاعة والتليفزيون المساعد، قسم الإعلام، كلية الآداب، جامعة السلطان قابوس.

من حكايات “كليلة ودمنة” المُلهمة، كان هناك ثور قوي اسمه “شتربة” يعيش مع قافلة من التجار، لكنه انفصل عنها بسبب مرضه، حيث تركوه في إحدى الغابات قرب النهر، لكن لأنه قوي نجح مع مرور الوقت في استعادة قوته بفضل العُشب والماء، وأصبح صوته قويًا يهدر في الوادي من جديد. وعندما سمع الأسد “ملك الغابة” هذا الصوت الغريب خشيهُ، لأنه لم يعرف مصدره، وهنا استغل “كليلة ودمنة” الموقف، فذهب دمنة إلى الأسد وأقنعه بأن يعرف حقيقة الصوت، ثم ذهب إلى الثور وأقنعه أيضًا بأن الأسد يريد صداقته.

وهكذا نجح دمنة في تقريب الاثنين، حتى نشأت صداقة قوية بين الأسد والثور، وصار الثور من أقرب الأصدقاء المقربين إلى ملك الغابة.

هذه الحكاية، تأخذنا إلى أنه فيما مضي من تاريخ الحروب اعتمدت الدول على التفوق العسكري المباشر من حيث امتلاك السلاح التقليدي “دبابات وطائرات.. الخ” باعتبارها الوسيلة القادرة على إحداث أكبر خسائر للعدو وهو ما يسمي بالإدارة التقليدية للحروب، لكن مع ظهور ونمو الذكاء الاصطناعي لم تعد التكنولوجيا مجرد تقنية، بل أصبحت وسيلة حربية لها قدرة على جمع البيانات الضخمة وتحليلها بسرعة تفوق قدرات الإنسان.

وأدى هذا التحول إلى ظهور مفهوم الحرب الخوارزمية Algorithmic Warfare الذي يشير إلى استخدام الخوارزميات والأنظمة الذكية لتحليل كميات ضخمة من البيانات العسكرية والاستخباراتية وبناء نماذج رقمية لساحات المعركة على نحو يضمن المناورة بعشرات السيناريوهات ومحاكاة مئات الظروف للوصول إلى الخطة الهجومية الأكثر كفاءة وفاعلية (Allen & Chan, 2017; Department of Defense, 2017; Scharre, 2018).

وانتقل مفهوم الحرب الخوارزمية باستخدام الذكاء الاصطناعي من مجرد آداه متفوقة في تحليل صور الأقمار الصناعية والاستخباراتية إلى دور “الثور”صديق «الأسد» في “كليلة ودمنة”، حيث أصبح ما يقدمه الـAI من إمكانيات علميه ضخمة وقدراته فائقة على محاكاة العمليات العسكرية والتنبؤ بنتائجها بأسلوب علمي دقيق، الصديق الصدوق للأسد الأمريكي.

وأوضحت تقارير صحفية عديدة عن اعتماد القوات الأمريكية خلال العمليات الأخيرة في إيران على نموذج الذكاء الاصطناعي Claude لتحليل البيانات العسكرية والاستخباراتية الواردة سواء كانت صور من الأقمار الصناعية أو بيانات ضخمة عبر اعتراض الاتصالات كما يمكن أن يلعب Claude دورًا مهمًا في إجراء عمليات محاكاة عسكرية واسعة النطاق للتنبؤ بردود الفعل الإيرانية المحتملة وتحسين خطط الهجوم (Copp&Dwoskin, 2026; Pabst, 2026).

وهنا السؤال الذي يطح نفسه.. كيف توطدت هذه العلاقة بين الأسد الأمريكي والثور الهادر «الأنظمة الذكية» لهذا المستوى المتقدم؟ وهل بدأ كل ذلك فجأة خلال الحرب على إيران؟

في الواقع الإجابة لا.. فلقد بدأت هذه المسيرة منذ العام 2018 عندما أطلق البنتاجونProject Maven والذي أصبح معروفًا عالميًا عندما تم اكتشاف أن Google ساعدت وزارة الدفاع الأمريكية في تحليل صور «الدرونز»، وتحديد الأهداف داخل صور الأقمار الصناعية، مما فجّر احتجاجات داخلية بين موظفي الشركة، وتحت ضغط هذه الاحتجاجات الداخلية أعلنت Google أنها لن تجدد عقدها مع وزارة الدفاع بعد انتهاء مدته (Reuters, 2018; Wired, 2021)، لكن المشروع نفسه لم يتوقف؛ بل استمر داخل البنتاجون عبر آخرين.

وابتداء من الربع الأول إلى الثالث عام 2024، بدأت وزارة الدفاع الأمريكية توسيع مشروع Project Maven ليصبح منصة تحليل عسكري شاملة في هذه المرحلة تم إدخال تقنيات Palantir Ontology لتنظيم البيانات العسكرية الضخمة وتحويلها إلى نموذج تحليلي موحد يمكن للأنظمة الذكية التعامل معه.

وفي مايو 2024 حصلت Palantir على عقد بقيمة 480 مليون دولار من وزارة الدفاع الأمريكية لتطوير نموذج Maven Smart System الجديد ووصفته وكالات أنباء بأنه يدمج بيانات من مصادر متعددة لمساعدة الجيش على تحديد نقاط الاهتمام العسكرية وتسريع عمل محللي الاستخبارات. (Reuters, 2024; Department of Defense, 2024; Palantir Technologies, 2024).

استمرت هذه العلاقة في الصعود والتنامي.. وفي الفترة من أكتوبر إلى ديسمبر 2024 بدأت التجارب الأولية لاستخدام النماذج اللغوية الكبيرة في تحليل البيانات الاستخباراتية. وتم اختبار نماذج الذكاء الاصطناعي في تحليل التقارير الاستخباراتية وتلخيص البيانات العسكرية ليس ذلك فحسب، بل ودعم اتخاذ القرار التكتيكي (Reuters, 2024; U.S. Department of Defense, 2024).

أعلنت OpenAI شراكة مع Anduril، أيضا في هذه الفترة، وهي شركة دفاعية معروفة جدًا في الأنظمة الذاتية والمضادة للطائرات المسيّرة، من أجل تطوير واستخدام AI في مهام الأمن القومي مع تركيز أولي على أنظمة مكافحة الدرونز. ((Reuters, 2024; Anduril Industries, 2024.

وتطورت بعدها العلاقة أكثر وأكثر حيث شهد عام 2025 انتقال الذكاء الاصطناعي من مرحلة الاختبار إلى مرحلة الدمج الفعلي داخل بنية القيادة العسكرية، حيث تم ربط الأنظمة الذكية بمصادر البيانات التالية من صور الأقمار الصناعية والطائرات المسيرة وتحليل بيانات اعتراض الاتصالات العسكرية وفي يونيو من نفس العام فازت OpenAI بعقد دفاع أمريكي بقيمة 200 مليون دولار لتطوير أدوات AI تخدم مواجهة تحديات الأمن القومي الأمريكي.

وأعلنت وزارة الدفاع الأمريكية أيضًا عقودًا تصل إلى 200 مليون دولار «لكل شركة» من شركات الذكاء الاصطناعي، بينها OpenAI وAnthropic وGoogle وXAI، مما يوضح أن الإدارة الأمريكية كانت تريد عدم الارتهان لمورّد واحد، بل بناء سوق تنافسية للنماذج داخل المنظومة الأمنية. بحيث لا تعتمد على شركة واحدة تتحكم في قرارها، وبحلول منتصف 2025 ذكرت وكالات أن Anthropic كانت قد وقّعت هي الأخرى عقدًا بقيمة 200 مليون دولار مع البنتاجون. (Reuters, 2025a, 2025b; Anthropic, 2025.

وفي ذات الوقت، أشارت تقارير متنوعة إلى اختراق أنظمة المراقبة داخل العاصمة الإيرانية، وبخاصة كاميرات المرور المنتشرة في الشوارع القريبة من المقار الحساسة والمجمعات الحكومية التي يرتادها كبار المسؤولين الإيرانيين.

ولم يكن الهدف من هذا الاختراق مجرد جمع صور ثابتة أو تتبع مشهد مروري عام، بل تحويل هذه الكاميرات إلى منصات إستخباراتية حية تنتج تدفقًا بصريًا مستمرًا عن البيئة الأمنية المحيطة بالأهداف.

وذكرت التقارير -الغير المؤكدة علميًا- أن الكاميرات مكنت القائمين على العملية من ملاحظة التفاصيل اليومية الصغيرة التي تبدو عادية ظاهريًا، مثل الأماكن التي يفضل الحراس الشخصيين والسائقين إيقاف سياراتهم فيها، وأنماط الدخول والخروج، والمسارات الأكثر استخدامًا حول المواقع المحصنة.

هذه التفاصيل، التي قد تبدو هامشية للقارئ في الوهلة الأولي، تتحول في العمل الإستخباراتي إلى وحدات معرفة بالغة القيمة عندما تُجمع على مدى زمني طويل وتُحلل داخل منظومات خوارزمية قادرة على اكتشاف التكرار والانحراف والروتين اليومي.

وفي الأدبيات الاستخباراتية يُعرف هذا النوع من العمل باسم تحليل نمط الحياة أو Pattern of Life Analysis وهو أحد أكثر أدوات الاستخبارات المعاصرة أهمية في التعامل مع الأهداف عالية القيمة. (Financial Times, 2026; Berman, 2026; DARPA, 2010)

هكذا تنامت العلاقة تدريجيًا بين «الأسود والثيران» من تحليل البيانات الضخمة ومحاكاة السيناريوهات العسكرية إلى بناء بنك الأهداف وإدارة تدفق المعلومات أثناء المعركة.

وكشفت العمليات العسكرية الأخيرة المرتبطة بالصراع مع إيران عن تحول عميق في طبيعة الحروب المعاصرة. فهذه العملية لم تكن مجرد مواجهة عسكرية تقليدية تعتمد على التفوق في القوة الجوية أو الصاروخية، بل كانت مثالًا واضحًا على دخول عنصر جديد إلى منظومة الصراع الدولي، وهو الخوارزميات والذكاء الاصطناعي.(Allen & Chan, 2017; Scharre, 2018; Department of Defense, 2017).

ويمثل هذا التحول بداية مرحلة جديدة في تطور الحروب، حيث لم تعد القوة العسكرية تُقاس فقط بعدد الطائرات أو الصواريخ أو الجنود، بل أصبحت تعتمد أيضًا على القدرة على جمع البيانات وتحليلها بسرعة وكفاءة. فالدولة التي تمتلك بنية تحليلية قادرة على معالجة المعلومات الاستخباراتية في الزمن الحقيقي تستطيع أن تبني صورة أكثر دقة لساحة المعركة، وأن تتوقع سلوك الخصم، وأن تتخذ قرارات عملياتية أسرع وأكثر فاعلية. ومن هذا المنطلق أصبحت البيانات نفسها أحد أهم موارد القوة في الصراعات الدولية المعاصرة.

لكن تقول الحكاية في “كليلة ودمنة” أن هذه الصداقة التي نشأت وتوطدت عبر سنوات بين “الأسد والثور” قد أثارت الغيرة في نفس دِمْنَة، فخاف أن يفقد مكانته عند الأسد، فبدأ يزرع الشكوك بينهما بخبث شديد، إذ أخبر الأسد بأن الثور يخطط للانقلاب عليه، وأوهم الثور في الوقت نفسه بأن الأسد يريد قتله.

ومع تصاعد الشك والخوف بين الطرفين، انتهى الأمر بمواجهة بين الأسد والثور، وقتله بعد صراع عنيف، وبعد وقوع المأساة أدرك الأسد أنه خُدع بالمكائد والوشايات، لكن بعد فوات الأوان.

وطالعتنا التقارير الإعلامية مؤخرًا إلى تصاعد الخلاف بين شركة أنثروبيك Anthropic المتخصصة في تطوير نماذج الذكاء الاصطناعي والإدارة الأمريكية، وذلك على خلفية قرار حكومي بتصنيف بعض تقنياتها ضمن قائمة المخاطر الأمنية المحتملة، لكن هذا التصنيف نادرًا ما تم لشركات أمريكية وفي الغالب كان يتم لشركات أجنبية تعمل داخل أمريكا وهو ما اعتبرته الشركة قرارًا تعسفيًا يضر بسمعتها وبقدرتها على العمل في السوق، خصوصًا في القطاعات المرتبطة بالعقود الحكومية والتكنولوجية الحساسة.

وتوضح التقارير أن هذا التصنيف قد يترتب عليه منع المتعاقدين مع الحكومة الأمريكية، بما في ذلك بعض الجهات المرتبطة بالمؤسسات الدفاعية، من استخدام تقنيات الشركة أو دمج نماذجها اللغوية المتقدمة في تطبيقاتهم، الأمر الذي قد يحد من انتشار منتجاتها في مجالات الذكاء الاصطناعي المتقدمة.

وقامت الشركة برفع دعوى قضائية ضد الإدارة الأمريكية منذ أيام قليلة مطالبة بإلغاء هذا التصنيف، مؤكدة أن قرار إدراجها في هذه القائمة يفتقر إلى الأساس القانوني أو التقني الكافي، وأنه قد يكون مرتبطًا بمواقف الشركة المعلنة بشأن الاستخدامات العسكرية لتقنيات الذكاء الاصطناعي، حيث سبق أن أبدت تحفظات على توظيف هذه النماذج في أنظمة الأسلحة أو العمليات العسكرية الهجومية.

وتضيف التقارير أن هذا النزاع يعكس توترًا متزايدًا بين شركات التكنولوجيا المتقدمة والحكومات، خاصة في ظل المنافسة العالمية على تطوير تقنيات الذكاء الاصطناعي واستخدامها في المجالات الأمنية والعسكرية، حيث تتمسك دوماً أنثروبيك بعدم استخدام تقنياتها في المراقبة المحلية العامة أو في الأسلحة ذاتيه التشغيل (العربية، 2026؛ سكاي نيوز عربية، 2026؛ العربي الجديد، 2026).

هذا هو نفس الصدام الذي حدث بين “الثور والأسد”، إذ بدأت شركات الذكاء الاصطناعي تشعر أن الإدارة الأمريكية تستخدم تقنياتها بطريقة تتعارض مع محددات الاستخدام التي أقرتها، في نفس الوقت فإن الأسد لا يقبل للثور أن ينقلب عليه بعد أن كان صديقة المقرب، غير أن هذا التحول يطرح في الوقت نفسه مجموعة من الأسئلة المعقدة المتعلقة بمستقبل الحرب ودور الإنسان في اتخاذ القرار العسكري.

فمع دخول الذكاء الاصطناعي إلى غرف العمليات العسكرية، لم يعد القادة «الأسود» يعتمدون فقط على قوة خبرتهم الشخصية أو على التقارير البشرية التقليدية، بل أصبحوا يتعاملون مع منظومات تحليلية “ثيران” قادرة على تقديم تقديرات احتمالية وسيناريوهات متعددة للمعركة.

ورغم أن القرار النهائي يظل بيد الإنسان، فإن الصورة التي يبني عليها هذا القرار أصبحت تتشكل بدرجة متزايدة عبر الخوارزميات التي تعالج البيانات وتعيد تنظيمها.

وهنا تتبادر إلى الذهن تساؤلات ثلاث: الأول كيف سينتهي الصراع بينهما؟ هل تسود شركات التقنية القرار العسكري ويتحكم الثيران أم تنتهي الحكاية بهيمنة الأسود وإخضاع الثيران كما في الحكاية أم تحدث مفاجآت؟ والثاني كيف سيكون شكل حياة المدنيين إذا تمدد الاستخدام الخاص بالرصد والتتبع خارج سياق العمليات العسكرية ووصل إلى الإدارة المدنية؟.

هذين السؤالين هما محور الحديث القادم، أما السؤال الثالث فأتركه للقارئ ليفكر فيه وهو: إذا كان عمالقة شركات تطبيقات الذكاء الاصطناعي التوليدي هم “الثيران” وجنرالات الجيش الأمريكي هم “الأسود”.. فمن هو “ابن آوي” في القصة؟ وأين “دمنه” الذي اشغل الصراع؟ هذه أتركها لك القارئ العزيز لتستنتجها بنفسك.

قائمة المراجع:

1. ابن المقفع، عبد الله. (د.ت.). باب الأسد والثور. في كليلة ودمنة. مؤسسة هنداوي.https://www.hindawi.org/books/29061736/4/

2. العربية. (2026، 10 مارس). صدام الذكاء الاصطناعي: أنثروبيك تقاضي إدارة ترامب بعد إدراجها بالقائمة السوداء.https://www.alarabiya.net/technology/ai/2026/03/10/صدام-الذكاء-الاصطناعي-انثروبيك-تقاضي-ادارة-ترامب-بعد-ادراجها-بالقائمة-السوداء

3. سكاي نيوز عربية. (2026، 10 مارس). أنثروبيك تقاضي إدارة ترامب لرفع وصف الخطر الأمني عن تقنياتها.https://www.skynewsarabia.com/business/1857806-انثروبيك-تقاضي-ادارة-ترامب-لرفع-وصف-الخطر-الامني-تقنياتها

4. العربي الجديد. (2026، 10 مارس). «أنثروبيك» تتهم إدارة ترامب بالانتقام منها بسبب موقفها من الحروب.https://www.alaraby.co.uk/economy/أنثروبيك-تتهم-إدارة-ترامب-بالانتقام-منها-بسبب-موقفها-من-الحروب

5. Allen, G. C., & Chan, T. (2017). Artificial intelligence and national security. Belfer Center for Science and International Affairs, Harvard Kennedy School. https://www.belfercenter.org/publication/artificial-intelligence-and-national-security

6. Anduril Industries. (2024). Anduril and OpenAI collaborate on AI technologies for national security applications. Anduril Industries. https://www.anduril.com/news/openai-anduril-ai-national-security

7. Anthropic. (2025). Claude models for government and national security use. Anthropic. https://www.anthropic.com/news/claude-government-national-security

8. Associated Press. (2026). AI, Anthropic, Pentagon and the rise of autonomous weapons systems. https://apnews.com/article/ai-anthropic-pentagon-golden-dome-autonomous-weapons-6f3c45ff46172c1bf8658dea0098f3fe

9. Axios. (2024, November 8). Anthropic partners with Palantir and Amazon to deliver AI tools for defense. https://www.axios.com/2024/11/08/anthropic-palantir-amazon-claude-defense-ai

10. Berman, L. (2026, March 3). Report: Israel hacked Tehran traffic cameras to track Khamenei ahead of assassination. The Times of Israel. https://www.timesofisrael.com/report-israel-hacked-tehran-traffic-cameras-to-track-khamenei-ahead-of-assassination/

11. Copp, T., & Dwoskin, E. (2026, March 4). Anthropic’s AI tool Claude central to U.S. campaign in Iran. The Washington Post. https://www.washingtonpost.com/technology/2026/03/04/anthropic-ai-iran-campaign/

12. Defense Advanced Research Projects Agency (DARPA). (2010). Video and image retrieval and analysis tool (VIRAT) program. DARPA. https://www.darpa.mil/program/video-and-image-retrieval-and-analysis-tool

13. Department of Defense. (2017). Project Maven: Algorithmic Warfare Cross-Functional Team. U.S. Department of Defense. https://www.defense.gov/News/News-Stories/Article/Article/1254719

14. Department of Defense. (2017). Project Maven: Algorithmic Warfare Cross-Functional Team. U.S. Department of Defense. https://www.defense.gov/News/News-Stories/Article/Article/1254719

15. Department of Defense. (2024). Project Maven and the expansion of AI-enabled battlefield intelligence. U.S. Department of Defense. https://www.defense.gov/News/News-Stories/Article/Article/3736955

16. Financial Times. (2026, March 2). Inside the plan to kill Ali Khamenei. Financial Times.https://www.ft.com/content/bf998c69-ab46-4fa3-aae4-8f18f7387836

17. Pabst, S. (2026, March 5). US used ‘Claude’ AI targeting tools in Iran war. Responsible Statecraft. https://responsiblestatecraft.org/ai-war-iran/

18. Palantir Technologies. (2024). Palantir Ontology: A unified data layer for operational decision-making. Palantir Technologies. https://www.palantir.com/platforms/ontology/

19. Reuters. (2018, June 1). Google plans not to renew military deal protested by employees. https://www.reuters.com/article/technology/google-plans-not-to-renew-military-deal-protested-by-employees-source-idUSKCN1IX5YB/

20. Reuters. (2018). Deep in the Pentagon, a secret AI program to find hidden nuclear missiles. https://www.reuters.com/article/technology/deep-in-the-pentagon-a-secret-ai-program-to-find-hidden-nuclear-missiles-idUSKCN1J114J

21. Reuters. (2024, December 4). OpenAI partners with defense startup Anduril on AI for national security missions. Reuters. https://www.reuters.com/technology/openai-partners-defense-startup-anduril-ai-national-security-2024-12-04

22. Reuters. (2024, May 29). Palantir wins $480 million U.S. Army deal for AI battlefield system linked to Project Maven. Reuters. https://www.reuters.com/technology/palantir-wins-480-million-us-army-deal-maven-prototype-2024-05-29

23. Reuters. (2025, July 22). Pentagon awards contracts to AI firms including OpenAI, Anthropic, Google and xAI. Reuters. https://www.reuters.com/technology/pentagon-awards-ai-contracts-openai-anthropic-google-xai-2025-07-22

24. Reuters. (2025, June 10). OpenAI wins U.S. Defense Department contract worth up to $200 million for AI tools. Reuters. https://www.reuters.com/technology/openai-wins-us-defense-department-contract-200-million-ai-tools-2025-06-10

25. Reuters. (2025, June 16). OpenAI wins $200 million U.S. defense contract. https://www.reuters.com/world/us/openai-wins-200-million-us-defense-contract-2025-06-16

26. Reuters. (2026, February 28). OpenAI details layered protections in U.S. Defense Department pact. https://www.reuters.com/business/media-telecom/openai-details-layered-protections-us-defense-department-pact-2026-02-28

27. Reuters. (2026, January 29). Pentagon clashes with Anthropic over military AI use. https://www.reuters.com/business/pentagon-clashes-with-anthropic-over-military-ai-use-2026-01-29

28. Reuters. (2026, March 3). AI contract restrictions could threaten military missions, U.S. official says. https://www.reuters.com/business/ai-contract-restrictions-could-threaten-military-missions-us-official-says-2026-03-03

29. Reuters. (2026, March 4). Anthropic courted the Pentagon—here’s why it walked away. https://www.reuters.com/technology/anthropic-courted-pentagon-heres-why-it-walked-away-2026-03-04

30. Reuters. (2026, March 4). OpenAI looking for contract with NATO, source says. https://www.reuters.com/technology/openai-looking-contract-with-nato-source-says-2026-03-04

31. Reuters. (2026, March 4). Palantir faces challenge to remove Anthropic from Pentagon’s AI software. https://www.reuters.com/technology/palantir-faces-challenge-remove-anthropic-pentagons-ai-software-2026-03-04

32. Scharre, P. (2018). Army of none: Autonomous weapons and the future of war. W. W. Norton & Company. https://wwnorton.com/books/Army-of-None/

33. TechCrunch. (2024, November 7). Anthropic teams up with Palantir and AWS to sell its AI to defense customers. https://techcrunch.com/2024/11/07/anthropic-teams-up-with-palantir-and-aws-to-sell-its-ai-to-defense-customers

34. The Guardian. (2026, February 28). OpenAI and the U.S. military: The growing debate over AI and defense partnerships. https://www.theguardian.com/technology/2026/feb/28/openai-us-military-anthropic

35. The Washington Post. (2026, March 4). Anthropic AI and the U.S. campaign involving Iran. https://www.washingtonpost.com/technology/2026/03/04/anthropic-ai-iran-campaign/

36. The Washington Post. (2026, March 6). Anthropic’s Claude gains popularity inside the Pentagon. https://www.washingtonpost.com/technology/2026/03/06/anthropic-pentagon-claude-popularity/

37. U.S. Department of Defense. (2026, February 12). Pentagon pushing AI companies to expand tools to classified networks. Reuters (report citing Pentagon officials). https://www.reuters.com/business/pentagon-pushing-ai-companies-expand-classified-networks-sources-say-2026-02-12

38. Wired. (2021, November 18). 3 years after the Project Maven uproar, Google cozies to the Pentagon. https://www.wired.com/story/3-years-maven-uproar-google-warms-pentagon/

39. Wired. (2024). OpenAI, the Defense Department, and Microsoft’s role in military AI policies. https://www.wired.com/story/openai-defense-department-ban-military-use-microsoft/